Website-Analyse

Website-Analyse

GEOlyze crawlt Ihre Website und analysiert sie auf Faktoren, die beeinflussen, wie KI-Systeme Ihr Unternehmen wahrnehmen und empfehlen. Die Ergebnisse fließen in die Diagnose ein und liefern umsetzbare Erkenntnisse zur Verbesserung Ihrer KI-Lesbarkeit.

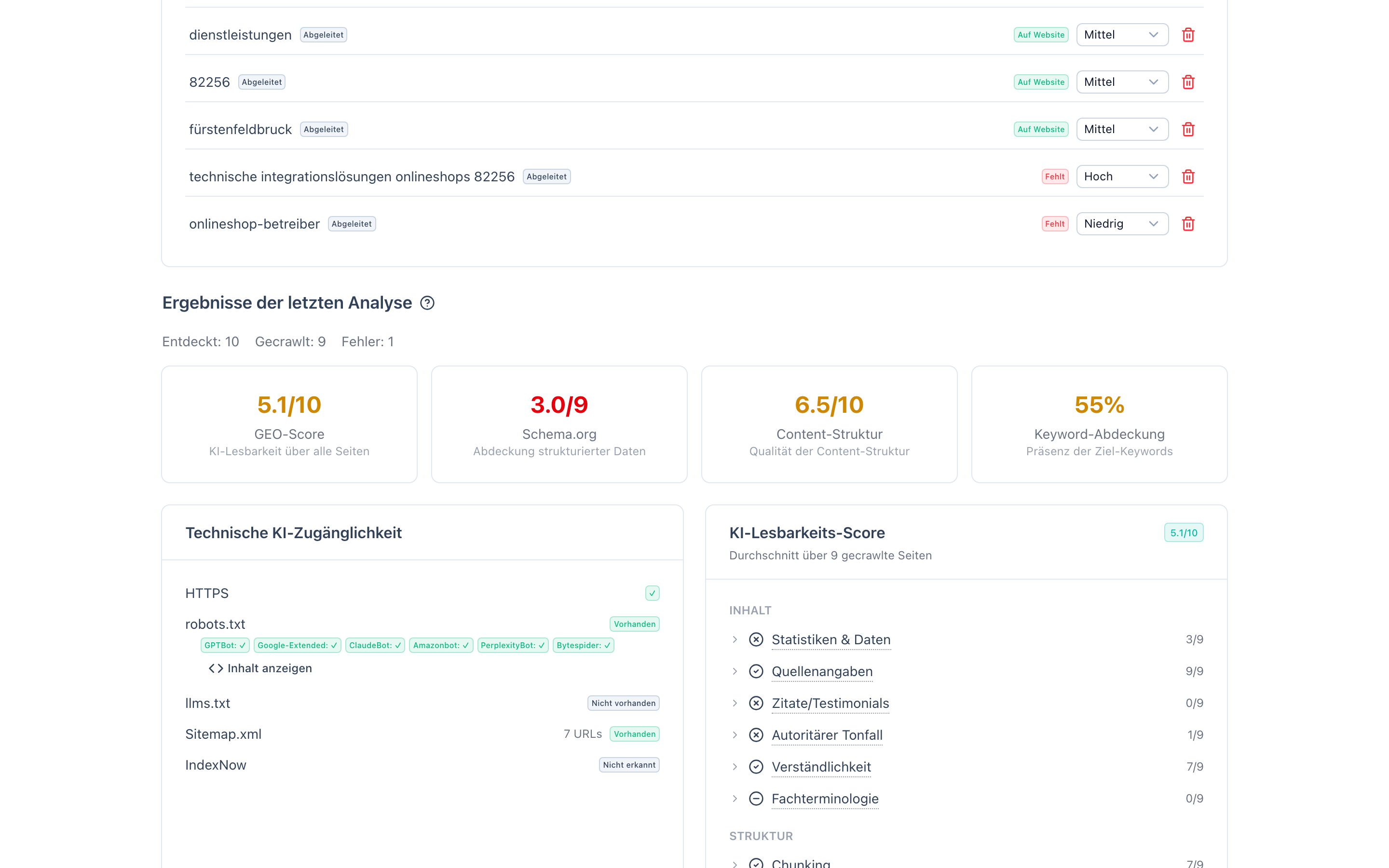

Bewertungen

Die Website-Analyse liefert vier Bewertungen, die als klickbare Karten oben auf der Seite angezeigt werden. Ein Klick auf eine Karte scrollt zum entsprechenden Detailabschnitt.

GEO-Readiness-Score (0--10)

Misst, wie gut jede Seite für KI-Lesbarkeit optimiert ist, gemittelt über alle gecrawlten Seiten. Der Score basiert auf 10 Kriterien, die pro Seite ausgewertet und in Content- und Struktur-Kategorien gruppiert werden:

Content-Kriterien:

- Statistiken und Daten -- Vorhandensein quantitativer Daten, Studien oder Forschungsreferenzen.

- Quellenangaben -- Verweise auf autoritative Quellen.

- Zitate und Testimonials -- Kundenstimmen oder Expertenzitate.

- Autoritativer Ton -- klare, selbstbewusste Sprache über Ihr Angebot.

- Lesbarkeit -- Textstruktur und Verständlichkeitsniveau.

- Terminologie -- Verwendung branchenrelevanter Begriffe passend zu Ihrem konfigurierten Angebot.

Struktur-Kriterien:

- Chunking -- Inhalte in gut verdauliche Abschnitte organisiert.

- Listen und Tabellen -- strukturierte Datenpräsentation für einfaches KI-Parsing.

- Umgekehrte Pyramide -- Schlüsselinformationen zuerst präsentiert.

- FAQ-Abschnitte -- Inhalte im Frage-Antwort-Format.

Jedes Kriterium wird pro Seite als grün (gut), gelb (teilweise) oder rot (fehlend) bewertet. Sie können auf jedes Kriterium klicken, um eine seitenweise Aufschlüsselung zu sehen, die zeigt, welche Seiten bestehen, teilweise bestehen oder durchfallen.

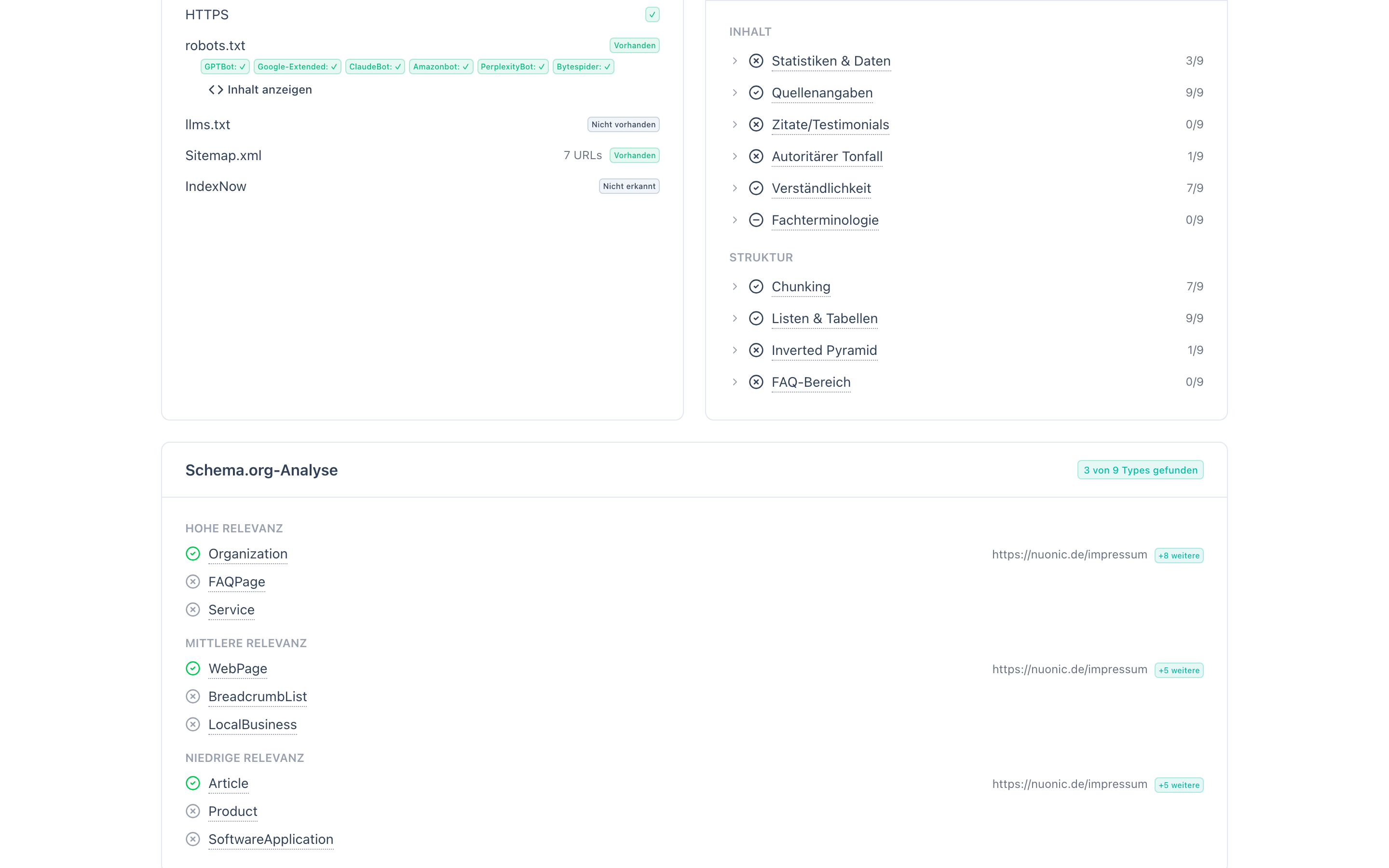

Schema.org-Score

Bewertet, wie gut Sie strukturierte Daten implementiert haben. Neun GEO-relevante Schema-Typen werden geprüft, gruppiert nach Relevanz:

Hohe Relevanz:

- Organization -- Unternehmensidentität (Name, URL, Logo, Kontaktdaten).

- FAQPage -- FAQ-strukturierte Inhalte.

- Service -- Dienstleistungsbeschreibungen.

Mittlere Relevanz:

- WebPage -- allgemeines Seiten-Markup.

- BreadcrumbList -- Navigationsstruktur.

Kontextabhängige Relevanz (Wichtigkeit hängt von Ihrem Geschäftstyp ab):

- LocalBusiness -- für Unternehmen mit physischen Standorten.

- Article -- für Websites mit Blog- oder redaktionellen Inhalten.

- Product -- für E-Commerce-Websites.

- SoftwareApplication -- für SaaS-Unternehmen.

Für jeden Typ zeigt die Analyse, ob er gefunden wurde, auf welchen Seiten und welche erforderlichen Eigenschaften fehlen. Tooltips erklären den Zweck jedes Schema-Typs.

Content-Score (0--10)

Bewertet Ihre gesamte Inhaltsstruktur und -qualität über alle gecrawlten Seiten. Zehn Prüfungen werden ausgewertet:

- Über-uns-/Unternehmensseite vorhanden.

- Blog- oder Wissensbereich vorhanden.

- Durchschnittliche Absatzlänge ist angemessen.

- Seiten haben ausreichende Wortanzahl.

- Überschriften-Hierarchie ist korrekt strukturiert.

- Bilder enthalten Alt-Texte.

- Call-to-Action-Signale sind vorhanden.

- Starke Entity-Aussagen über Ihr Unternehmen sind vorhanden.

- Regionale/Standort-Referenzen sind enthalten.

- Interne Verlinkung ist ausreichend.

Jede Prüfung führt zum Status bestanden, Warnung oder durchgefallen und trägt zum Gesamtscore bei.

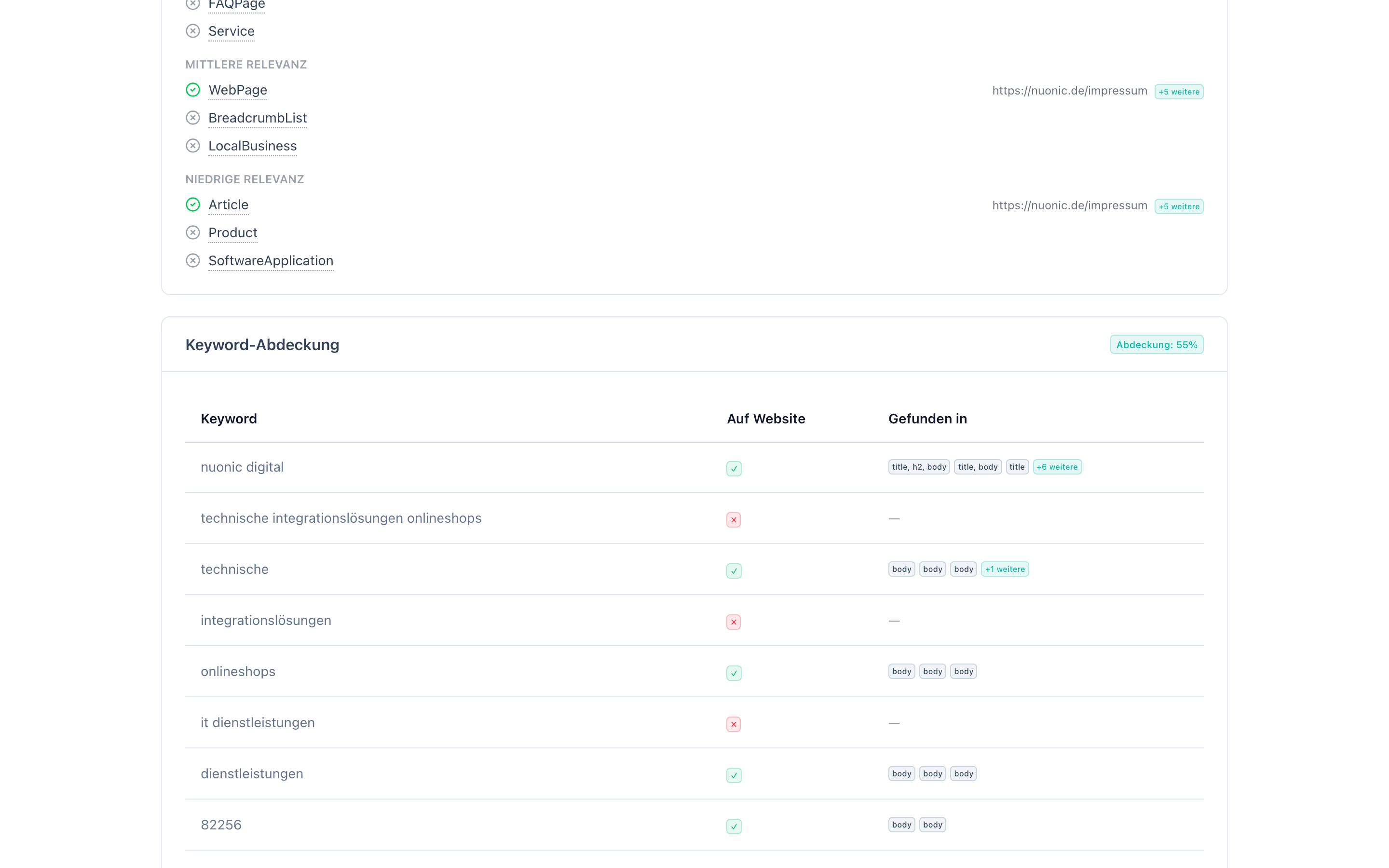

Keyword-Abdeckung

Prozentsatz Ihrer Ziel-Keywords, die auf der Website gefunden wurden. Die detaillierte Tabelle zeigt:

- Welche Keywords gefunden wurden und auf welchen Seiten (mit Kontexten: Titel, H1, H2, Fließtext).

- Welche Keywords komplett fehlen.

- Welche Keywords gut abgedeckt sind (in prominenten Positionen wie Titeln oder Überschriften gefunden).

Technische Prüfungen

Eine Karte mit dem Status kritischer technischer Faktoren:

- HTTPS -- ob die Website konsistent über HTTPS ausgeliefert wird.

- robots.txt -- ob die Datei existiert, mit dem Status jedes KI-Crawlers (GPTBot, Google-Extended, ClaudeBot, Amazonbot, PerplexityBot, Bytespider). Blockierte Crawler werden markiert. Der vollständige robots.txt-Inhalt kann zur Überprüfung aufgeklappt werden.

- llms.txt -- ob eine llms.txt- oder llms-full.txt-Datei existiert, ob ihr Format gültig ist (beginnt mit einer Markdown-H1-Überschrift und enthält mindestens eine URL), und der Inhalt kann eingesehen werden.

- sitemap.xml -- ob eine Sitemap existiert und wie viele URLs sie enthält.

- IndexNow -- ob eine IndexNow-Integration erkannt wurde (für schnelle Seiten-Neuindexierung).

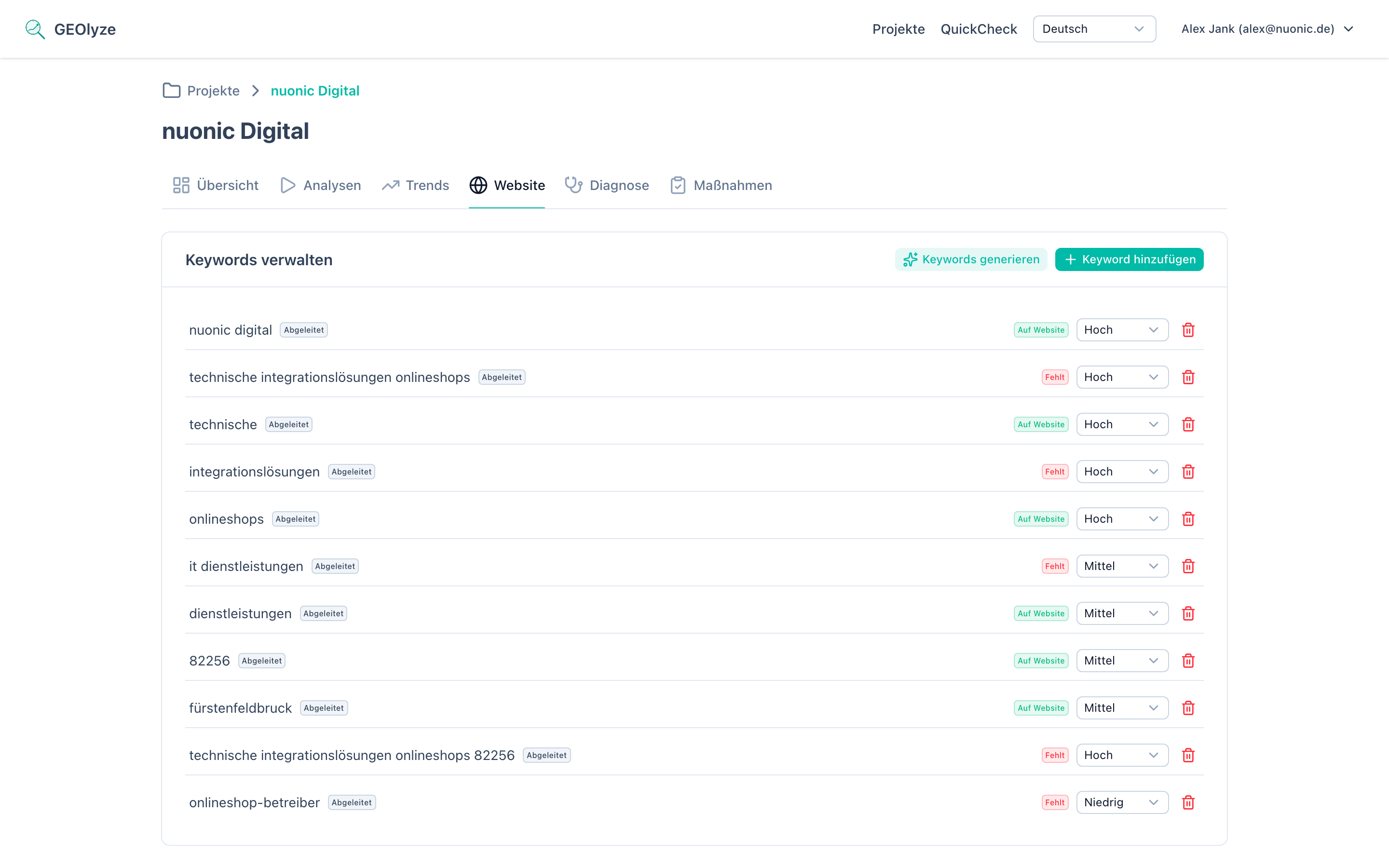

Keyword-Manager

Definieren und verwalten Sie Ihre Ziel-Keywords direkt auf der Website-Analyseseite. Keywords werden für Abdeckungsbewertung, Diagnose-Gap-Analyse und Empfehlungen verwendet.

- Keywords manuell hinzufügen -- geben Sie ein Keyword ein und legen Sie seine Priorität fest (hoch, mittel oder niedrig).

- Keywords automatisch generieren -- nutzen Sie den KI-gestützten Keyword-Generator, um Keywords aus Ihrem Unternehmensprofil abzuleiten (Unternehmensname, Angebot, Branche, Zielgruppe, Standort). Ein zweiter Generierungsschritt kann zusätzliche KI-vorgeschlagene Keywords erzeugen.

- Priorität bearbeiten -- ändern Sie die Prioritätsstufe eines Keywords jederzeit.

- Keywords löschen -- entfernen Sie Keywords, die nicht mehr relevant sind.

Jedes Keyword zeigt seine Quelle (manuell, abgeleitet oder KI-generiert) und, wenn Crawl-Daten verfügbar sind, ob es auf der Website gefunden wurde oder fehlt.

Crawl-Metadaten

Oberhalb der detaillierten Ergebnisse werden Metadaten zum Crawl angezeigt:

- Entdeckte Seiten -- Gesamtzahl der beim Crawl gefundenen Seiten.

- Gecrawlte Seiten -- erfolgreich analysierte Seiten.

- Fehlerhafte Seiten -- Seiten, die nicht gecrawlt werden konnten (falls vorhanden).

Crawl-Einstellungen

In Ihren Projekteinstellungen können Sie konfigurieren:

- Website-Crawling während Analysen aktivieren oder deaktivieren.

- Maximale Seitenanzahl für den Crawl (Standard: 30), um zu steuern, wie tief der Crawler Ihre Website erkundet.